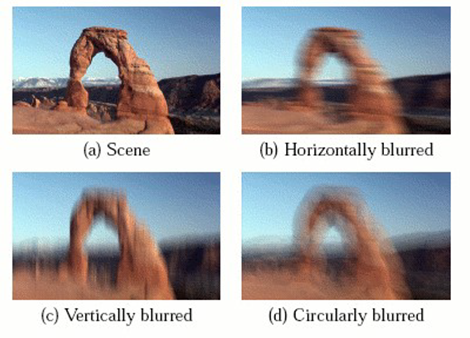

Анализ изображения — это процесс выделения нужной информации из изображения с помощью автоматических систем. Системы анализа не ограничиваются разделением областей сцены на фиксированное число классов. Они предназначены для описания сложных сцен, разнообразие которых может быть настолько большим, что их нельзя описать с помощью заранее заданных терминов [2]. В прикладных областях, связанных с цифровой обработкой изображений, актуальна задача распознавания образов и определения их положения, ориентации и масштаба относительно заданной системы координат [1]. В связи с этим необходимо, чтобы обрабатываемые изображения имели высокое качество и были достаточно четкими. Съемка изображений в условиях низкой освещенности или съемка быстро движущихся объектов может привести к значительному ухудшению качества изображения и его размытию (Рисунок 1).

Рисунок 1 – Размытие при движении: (а) – сцена, (b) – горизонтальное размытие, (с) – вертикальное размытие, (d) – круговое размытие

Этому способствует перемещение объекта относительно датчика в камере, в течение того времени, когда затвор камеры открыт. Иными словами, на размытие изображения влияют движение объекта и тряска камеры. Проблема особенно очевидна в условиях низкой освещенности, когда время экспозиции часто может длиться в течение нескольких секунд.

Существует несколько способов предотвращения размытия изображения при процессе съемки изображения или во время постобработки изображений по устранению смазывания при движении. Проблема смазывания актуальна, как и в обычных фотографиях, так и для таких приложений, как системы видеонаблюдения, в которых используются камеры низкого качества для съемки последовательностей фотографий движущихся объектов (например, людей).

Итак, современные методы предотвращения размытия изображения можно разделить на следующие категории:

· аппаратное обеспечение в оптической системе камеры для стабилизации изображения;

· постобработка изображения для устранения размытости при движении путем оценки движения камеры (по одной фотографии или по последовательности фотографий);

· гибридный подход, который измеряет движение камеры во время захвата фотографии.

Стабилизация изображения. Оптически стабилизированные объективы часто используются в видеокамерах и более дорогих фотокамерах, чтобы уменьшить влияние небольшой тряски камеры. Они используют систему гироскопов и инерциальных датчиков, чтобы обеспечить постоянство оптических систем камеры во время захвата изображения. Это действительно очень эффективно при процессе стабилизации камеры при относительно коротких экспозициях (менее 1/15-й секунды).

Другой аппаратный подход заключается в использовании настраиваемых датчиков изображений КМОП (CMOS), использующих технологию глобального затвора, в которой одновременно все строки пикселей подвергаются экспозиции. Именно поэтому технология глобального затвора идеально подходит для съемки быстродвижущихся объектов, с чем, разумеется, часто сталкиваются камеры, используемые в дорожно-транспортной сфере. [5] [6]. Однако это не решает проблему тряски камеры, когда требуется длительная выдержка из-за низкой освещенности.

Концепции оценки движения. Изображения формируются в камере посредством световой энергии, падающей на массив детекторов. Определенный минимальный уровень световой энергии должен падать на каждый пиксель для обнаружения света. Для достижения этого минимального уровня необходимо, чтобы время экспозиции, необходимое для того, чтобы пиксель обнаружил свет, было обратно пропорционально площади пикселя. При больших пикселях (низкое разрешение) время экспозиции может быть коротким. При меньших пикселях (более высокое разрешение) время экспозиции должно быть больше. Эта конкуренция между пространственным разрешением (числом пикселей) и временным разрешением (числом фотографий в секунду) является основным компромиссным разрешением [4].

Моделирование процесса формирования изображения. Для обработки изображений при устранении размытости изображения в качестве концептуальной отправной точки полезна модель процесса формирования изображения [3]. Представьте себе, что «идеальным» изображением является то, которое мгновенно фиксирует определенный момент времени и, следовательно, не смазывает объекты во время движения. Это изображение, которое мы пытаемся оценить в процессе движения без размытия. При съемке реальной фотографии, мы можем думать о недостатках процесса фотографии как о серии преобразований, примененных к этому идеальному изображению:

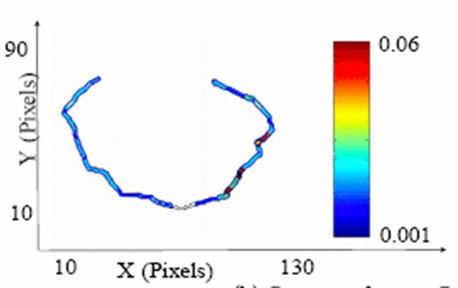

1. Затвор камеры определяет, когда сенсор камеры открыт или закрыт для света, поступающего через объектив. Длительность выдержки определяет, на какой промежуток времени сенсор будет открыт. От выдержки зависит размытие при движении. Свет, падающий из каждой точки сцены, вносит вклад в несколько разных пикселей в реальном изображении. Этот этап можно рассматривать как преобразование, отображающее каждый пиксель идеального изображения на несколько пикселей в реальном изображении в соответствии с функцией распределения точек (PSF) (см. Рисунок 2). Это действительно можно разделить на два преобразования – одно из которых соответствует функции разнесения точек, вызванной тряской камеры, а другая – движению объектов в мире относительно фотографа.

Рисунок 2 – пример функции рассеяния точек (ФРТ)

2. Оптическое размытие вызвано тем, что объектив не идеально фокусирует изображение на детекторе. Это можно смоделировать как функцию Гаусса.

3. Детектор имеет ограниченное разрешение, поэтому очень много пикселей в произвольно высоком идеальном изображении с высоким разрешением усредняются для получения значения для каждого пикселя в реальном изображении с более низким разрешением.

Чтобы удалить размытие движения, необходимо сформировать обратную функцию преобразования. Первый шаг для этого – определить исходную функцию движения или функцию точечного разброса (ФРТ) как можно точнее. Методы, обсуждаемые ниже, решают эту проблему несколькими различными способами.

Как только мы узнали ФРТ, мы можем восстановить исходное «идеальное» изображение, используя деконволюцию изображения, чтобы получить оценку идеального изображения из размытого изображения. Алгоритмы для осуществления этого процесса хорошо изучены. Поэтому необходимо только оценить этот ФРТ. ФРТ – функция плотности энергии, которая описывает количество света времени из одной точки сцены, предоставляет каждую (x, y) координату пикселя в детекторе изображения. Методы различаются по сложности оцениваемых ими ФРТ, от простых линейных функций перевода до непрерывных функций в 2D или даже 3D.

Оценка движения по одному изображению. Можно оценить функцию размытия движения при исследовании одного изображения, но для этого требуются предположения о функции движения, чтобы ограничить параметры потенциальных ФРТ. Этот метод называется деконволюцией слепого изображения и часто допускает, что движение было с постоянной скоростью или было линейным гармоническим движением, или было равномерным по всей сцене. Методы оценки функции обычно основываются на исследовании частот, присутствующих в изображении, для определения направления движения. Они очень ограничены в своем применении, поскольку движение обычно намного сложнее. Неправильная оценка ФРТ приводит к гораздо более серьезным артефактам, чем исходная проблема размытия движения.

Оценка движения по нескольким изображениям. Блейком и Зиссерманом [3] предложена методика, которая использует последовательность размытых в движении изображений, чтобы определить функции ФРТ и обработать каждое изображение. Первый шаг – это отслеживать объект на фотографиях. Это делается с помощью комбинации корреляция текстуры и выделения контура движущихся моделей. Это дает нам аффинную модель движения оценки движения объекта между последовательными изображениями.

Как только модель оценки получена, изображение без размытия получают путем минимизации разницы между последовательностью реальных изображений и изображений последовательности, полученных с применением модели, начиная с первого изображения в последовательности. Это делается с помощью минимизации разности наименьших квадратов путем сопряженного градиентного спуска. Добавлены ограничения гладкости для повышения устойчивости к шуму, присутствующему в изображении.

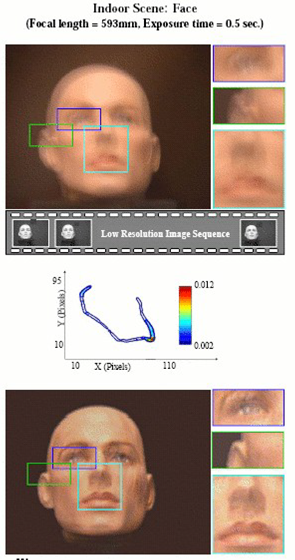

Оценка движения при захвате (гибридная визуализация). Другой подход, предложенный Эзрой и Наяром [4], использует фундаментальный компромисс между пространственным и временным разрешением для непосредственного измерения движения камеры во время захвата изображения. Основная идея состоит в том, что имеются два датчика: один датчик с высоким пространственным разрешением (количество пикселей), но с низким временным разрешением (захват изображения в секунду); второй датчик низкого качества с низким пространственным разрешением, но с высоким временным разрешением. Последовательность изображений, снятых вторым датчиком в течение времени экспозиции первого датчика, используется для определения функции распределения точки (ФРТ), которая описывает движение устройства во время захвата.

Как только у нас появятся эти дискретные образцы движения, они должны быть преобразованы в непрерывную ФРТ. Это делается в соответствии с несколькими ограничениями: энергия не должна быть ни потеряна, ни получена во время размытия, и функция должна быть непрерывной и дважды дифференцируемой из-за физических ограничений скорости и ускорения. Кроме того, мы можем предположить, что освещение сцены не меняется при получении изображений. Затем может быть применен любой из алгоритмов деконволюции к изображению с высоким пространственным разрешением, с использованием ФРТ для получения изображения без размытия. (Рисунок 3)

Рисунок 3 – Коррекция изображения с использованием гибридной визуализации